Kita hidup di timeline yang aneh, di mana kamera bukan lagi saksi, melainkan opini. Video AI, dari wajah yang disulap halus sampai suara yang disetel mirip, sudah cukup rapi untuk menipu grup keluarga WhatsApp yang paling skeptis sekalipun. Di satu sisi ada janji kreativitas tanpa batas, di sisi lain ada bencana kecil yang sunyi: nama baik dicuri, reputasi dihancurkan, pilihan politik digiring halus seperti iklan diskon di akhir bulan. Detektornya? Masih ngos-ngosan mengejar, sering kalah oleh trik sesimpel kompresi, potong, unggah ulang. Kesenjangan kualitas antara pembuat dan pendeteksi itulah jurang yang perlu kita timbun—bukan besok, tapi sekarang.

Di Indonesia, fondasi hukumnya ada, namun belum ada “pasal deepfake” yang eksplisit. UU PDP melindungi biometrik seperti wajah dan suara; UU ITE hasil perubahan kedua menguatkan kewajiban platform; PP TUNAS 2025 menambah pagar khusus untuk anak. Tapi untuk deepfake lintas konteks, politik, finansial, pornografik non-konsensual, kita masih mengandalkan kombinasi aturan lama dan kreativitas aparat. Sementara itu, pemerintah sudah memberi sinyal: ada roadmap AI, ada dorongan ke platform global untuk sediakan fitur cek konten AI, ada literasi digital yang digas. Ini momentum. Jika tak segera dirapikan, kita akan mengulang pola lama: kejahatan melesat, regulasi menyusul sambil terengah.

“Makin Halus, Makin Bahaya”: Kenapa Detektor Selalu Telat?

Di awal era deepfake, kita bisa menebak dari mata kaca dan kulit “lilin. Sekarang, generatif video dan audio makin licin. Deteksi AI memang berkembang, namun begitu konten masuk jalur medsos, kena kompresi, dipotong, atau direkam layar, performanya sering turun. Ini bukan gosip; laporan teknis menekankan risiko “domain shift”—alat yang akurat di dataset bersih belum tentu tangguh di lapangan. Kesimpulannya: deteksi perlu teman—label dan provenance yang bisa diverifikasi.

Di sisi watermark, narasinya mirip. Ada SynthID dari Google DeepMind, ada Video/Audio Seal dari Meta, ada sistem lain yang mengaku “tak terlihat tapi terdeteksi”. Bagus sebagai lapisan sinyal. Namun penelitian independen juga menunjukkan watermark bisa dilemahkan atau dihapus dengan teknik tertentu. Standar industri seperti C2PA (Coalition for Content Provenance and Authenticity) lebih menjanjikan di sisi provenance—“nutrisi label” yang merekam asal-usul & riwayat edit—tapi adopsinya belum merata, terutama di smartphone dan platform medsos. Teknologi ada, namun ekosistemnya belum rapat.

Baca juga artikel menarik lainnya: Saat Wajah Bisa Disalin, Suara Dimanipulasi, Kepercayaan Harus Dipersenjatai

Bukti Lapangan: Dari NIST ke Feed Medsos

Sebelum kita menyalahkan publik karena “gampang percaya”, ingat: deteksi di in-the-wild memang keras. Evaluasi NIST menekankan perlunya metrik yang lebih nyata, bukan hanya akurasi di dataset “bersih”, tapi ketahanan di konten hasil kompresi berulang. Beberapa studi terbaru bahkan menunjukkan error rate melonjak drastis saat model detektor bertemu audio dan video dari platform asli. Ini bukan alasan untuk menyerah, tetapi alarm bahwa strategi kita harus multi-lapis: provenance + watermark + deteksi + literasi + respons cepat.

NIST itu apa?

NIST (National Institute of Standards and Technology) adalah lembaga standar milik pemerintah AS di bawah Departemen Perdagangan. Mereka bikin kerangka dan panduan, dari keamanan siber sampai AI, termasuk laporan pengelolaan risiko konten sintetis (deepfake). Versi gampangnya: NIST itu “bengkel standar” yang menyusun praktik baik agar industri dan publik punya patokan yang jelas.

“Aturan Belum Rapi, Dampak Sudah Nyata”: Peta Regulasi Indonesia 2024–2025

Indonesia sudah punya pondasi: UU PDP mengklasifikasikan biometrik (wajah/suara) sebagai data pribadi spesifik; UU ITE (Perubahan Kedua, 2024) memperbarui sejumlah pasal strategis; Permenkominfo 5/2020 mewajibkan takedown 24 jam, dan 4 jam untuk kasus mendesak; PP TUNAS (2025) memperketat perlindungan anak di ruang digital. Yang belum: definisi deepfake, kewajiban label, provenance, dan jalur penegakan yang spesifik lintas platform.

Pemerintah—melalui Komdigi—sudah menabuh genderang: meminta platform global menyediakan fitur cek konten AI, memperkuat literasi, dan menggarap roadmap AI yang menekankan transparansi. Ini kabar baik, tapi skala masalah menuntut lebih dari imbauan. Kita perlu “gigi hukum” yang jelas: siapa wajib apa, dalam berapa jam, bukti apa yang diterima, dan jalur banding apa untuk korban.

Celah Praktis di Lapangan

Skenarionya sederhana: ada video deepfake fitnah, viral tengah malam. Korban lapor; platform mengkaji; saat take down selesai, narasi sudah menyeberang ke berbagai sosmed dan whatsapp group keluarga. Permen 5/2020 memang memberi SLA 24 jam/4 jam, tapi itu butuh komando tepat, klasifikasi kasus jelas, dan penegakan konsisten antar-platform. Tambahkan salinan di tempat lain dan unggah ulang, tanpa pencocokan sidik digital konten lintas platform dan mekanisme lapor-hapus lalu cegah muncul lagi, upaya jadi kucing-kucingan lintas platform.

Belajar dari Luar Negeri: Label Transparansi Bukan Sulap, Tapi Perlu

Uni Eropa dalam EU AI Act mewajibkan konten yang dibuat maupun dimodifikasi dengan AI wajib dilabel dengan jelas, agar pengguna tahu kapan mereka “bertemu” hasil AI, termasuk deepfake, kecuali untuk pengecualian terbatas. Spanyol bahkan menyiapkan denda besar jika AI-generated tidak diberi label.

Di sisi platform, ada upaya: YouTube merilis label “Captured with a camera” berbasis C2PA untuk menandai video yang betul-betul hasil kamera (bukan AI/modifikasi), sementara Meta menerapkan label “AI-generated” untuk konten tertentu—meski konsistensinya masih jadi pekerjaan rumah. Pelajaran kunci: tak ada satu peluru perak; negara mendorong label & provenance, industri menstandarkan dan platform menegakkan.

C2PA Itu Apa ?

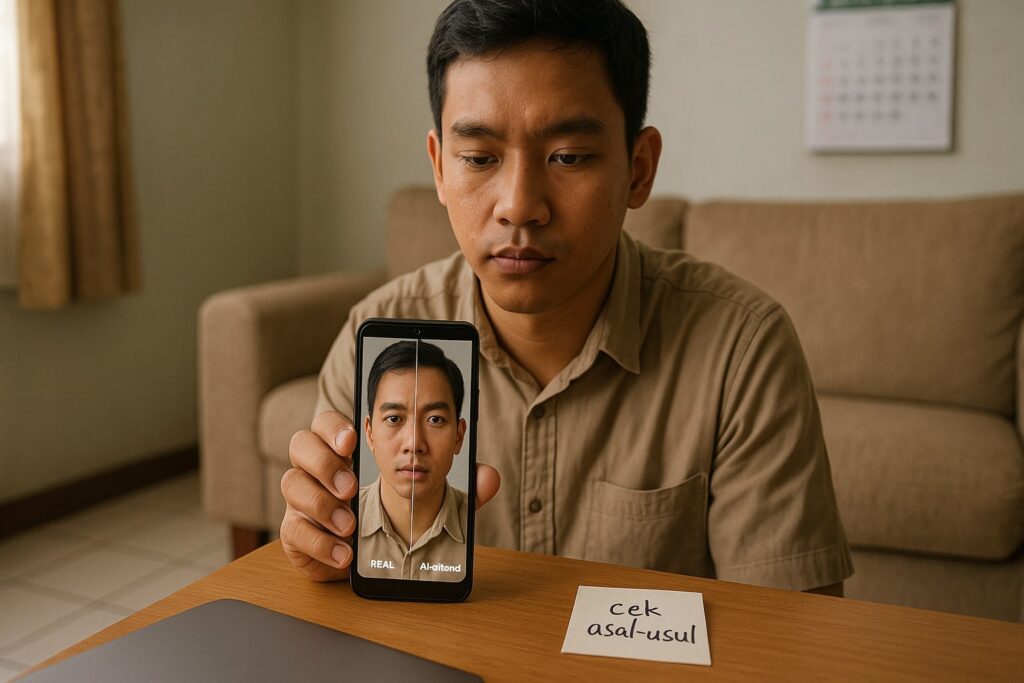

C2PA (Coalition for Content Provenance and Authenticity) adalah standar terbuka untuk “jejak proses” konten: siapa bikin, pakai alat apa, diedit apa saja—dibungkus sebagai Content Credentials yang bisa diverifikasi kriptografis (ibarat “label gizi” digital). Kalau platform dan perangkat kompak melestarikannya, publik bisa “cek asal-usul” sebelum percaya.

Apa yang Relevan untuk Indonesia?

Kita bisa mengadopsi prinsip-prinsip transparansi Uni Eropa tanpa menunggu perangkat super-canggih. Wajib label untuk konten hasil AI, kewajiban platform membaca & mempertahankan provenance (C2PA) sejauh didukung, dan peta jalan watermark minimal untuk konten yang dihasilkan layanan state-of-the-art. Kuncinya interop: kebijakan jangan dikunci ke vendor spesifik, tapi mendefinisikan hasil (dapat diverifikasi, tahan manipulasi umum, bisa diaudit).

Rencana Aksi 12 Bulan: Dari “Himbauan” ke Kewajiban yang Tegas

Regulasi yang efektif itu seperti marka jalan, bukan polisi tidur di tiap tikungan. Ia membiarkan inovasi melaju, namun memberi sanksi saat ada yang nekat ke jalur berlawanan. Indonesia punya modal regulasi dan momentum politik. Tantangannya adalah merangkum semua potongan—UU PDP, UU ITE, PP TUNAS, takedown ke dalam kerangka kerja synthetic media yang jelas, operasional, dan bisa diawasi publik.

1) Definisi & Klasifikasi Deepfake (Wajib)

Jangan longgar, jangan kabur. Definisikan deepfake dan synthetic media (video, audio, gambar) serta kelas risiko: politik & pemilu, finansial/penipuan, pornografik non-konsensual, dan hiburan/eksperimen. Ini menentukan SLA dan sanksi.

WhatsApp Channel · TitikTerang

Dapatkan kilasan berita, analisis pedas, dan cerita ekologis ala TitikTerang langsung di WhatsApp-mu. TitikTerang hadir di WhatsApp

2) Kewajiban Label untuk High-Risk Synthetic Media**

Tekankan transparansi ala EU—siapa pun yang menyebarkan konten sintetis berisiko wajib memberi label yang jelas di metadata dan tampilan. Platform wajib menjaga label saat re-upload.

3) Provenance-by-Default untuk PSE Besar

PSE besar (ambang pengguna atau traffic) wajib membaca, menampilkan, dan menjaga kredensial C2PA bila tersedia; dorong program pilot dengan media, kamera, dan kreator lokal. Cloudflare dan YouTube sudah menguji integrasi C2PA; kita bisa minta platform di Indonesia menyalakan “preserve credentials” secara default.

4) Watermark: Bukan Sihir, Tetap Penting

Minta layanan AI besar yang beroperasi di Indonesia memakai watermark yang terdokumentasi (mis. SynthID/Video Seal) plus pernyataan batasan. Tekankan bahwa watermark bukan bukti tunggal, hanya salah satu sinyal.

5) Rapid Takedown & Staydown untuk Kasus Prioritas

Perkuat Permen 5/2020 dengan kategori “prioritas ekstrem” (mis. non-consensual intimate deepfake, ancaman keamanan pemilu) dengan SLA ≤4 jam lintas platform termasuk hash-matching dan staydown.

6) Hak & Jalur Banding Korban

Sediakan form banding terpadu lintas PSE: unggah bukti, minta pemeriksaan forensik, fast-track untuk kasus pornografi non-konsensual & pemilu.

7) Audit, Transparansi, & Incident Reporting

Wajib laporan triwulan: volume konten berlabel AI, takedown, waktu respons median, repeat offenders. NIST-style evaluation bisa diadopsi sebagai uji ketahanan deteksi PSE (bukan cuma demo lab).

8) Sanksi Progresif & Safe Harbor untuk Pelapor Baik

Mulai dari warning, denda, sampai pembekuan fitur unggah massal. Berikan safe harbor untuk media maupun peneliti yang mengungkap deepfake secara bertanggung jawab (dengan konteks edukasi).

9) Pendidikan Pengguna: “Cek Asal, Bukan Cuma Cek Rasa”

Bangun modul literasi yang mengajarkan publik mengecek asal-usul (Content Credentials), bukan hanya firasat. Kita butuh kebiasaan baru: lihat label sumber sama rutin seperti lihat tanggal kedaluwarsa.

Tekno Bukan Dogma: Menggabungkan Label, Kredensial, dan Deteksi

Jangan jatuh pada “solusi tunggal”. Deteksi bagus untuk screening massal, watermark bagus untuk sinyal asal, C2PA bagus untuk jejak proses. Tiga serangkai ini, ditambah penegakan cepat dan jalur banding korban, baru terasa seperti ekosistem, bukan tambalan. Industri juga harus jujur soal keterbatasan, baik DeepMind maupun Meta sudah mengakui batas watermark, dan peneliti independen rutin “membobol” pendekatan yang dianggap mapan. Itu sehat; yang tak sehat adalah pura-pura aman.

Kenapa C2PA Layak Jadi Tulang Punggung

Sedikit pemanasan: C2PA bukan “detektor keaslian”, melainkan standar untuk merekam asal-usul. Ia seperti logbook digital: siapa membuat, alat apa, kapan diubah. Kamera, software, CDN, dan platform bisa ikut menempelkan credential. Nikon, Adobe, dan ekosistem CAI mengeksekusi ini; Cloudflare dan YouTube mulai merapat. Kalau ini jadi kebiasaan industri, publik punya kebiasaan baru: cek kredensial sebelum percaya.

Politik & Pilkada: Deepfake Bukan Lagi Cerita Luar Negeri

Beberapa tahun terakhir, Bawaslu dan Kominfo sudah mewanti-wanti eskalasi konten manipulatif menjelang kontestasi. Sorotan utamanya memang hoaks, namun deepfake jadi variabel berbahaya—murah, cepat, emosional. Kabar baiknya: kolaborasi pencegahan sudah dilakukan; kabar buruknya: tanpa kerangka deepfake yang tegas (label, rapid takedown, sanksi), ini akan jadi permainan “tebak-asli” di detik terakhir.

Pelajaran dari Uni Eropa dan AS

Uni Eropa bergerak lewat kewajiban transparansi; beberapa yurisdiksi di AS mendorong label wajib dan dukungan watermark saat periode elektoral. Intinya: lebih baik publik “terlalu banyak label” daripada “terlambat tahu palsu”. Indonesia bisa meniru prinsip ini, menyesuaikan budaya & hukum lokal.

Dampak ke Pengguna Nyata: Dari UMKM sampai Siswa SMA

Deepfake bukan masalah selebritas saja. UMKM bisa kena penipuan suara bos palsu; orang tua bisa terjebak video “anak minta tolong”; siswa bisa jadi korban deepfake intim tanpa persetujuan (konten seksual palsu berbasis AI tanpa izin korban); jurnalis diserang reputasinya dengan suara palsu. Di level ekonomi, setiap kebohongan visual menggerus kepercayaan, dan kepercayaan adalah pelumas transaksi digital. Aturan yang tegas bukan anti-inovasi, tapi pro-trust. (Lihat juga dorongan Komdigi soal literasi & perlindungan anak sebagai pagar awal).

Kepercayaan Itu Mata Uang, Bukan Sekadar Fitur

Dunia digital kita berjalan di atas kepercayaan yang tak terlihat, seperti oli di mesin angkot. Sekali oli habis, mesin bisa tetap hidup sebentar tapi gesekannya mematikan. Deepfake menggerus oli itu pelan-pelan: bukan lewat satu video viral, melainkan ribuan micro-cuts yang membuat kita sinis pada segalanya. Regulasi yang tegas—label, provenance, takedown, sanksi—bukan rem inovasi; ia sabuk pengaman agar laju tak berakhir di jurang. Kita sudah punya pondasi (PDP, ITE, TUNAS), tinggal menyusun lex specialis yang jelas dan bisa dieksekusi. Industri pun harus berhenti menjual “sihir” dan mulai membangun alat yang interoperable serta terbuka diaudit. Pada akhirnya, kita tidak sedang perang melawan teknologi, melainkan melawan ketidakpastian yang disengaja. Di negeri dengan grup WhatsApp paling aktif sedunia, menjaga kepercayaan adalah infrastruktur nasional—dan ya, infrastruktur itu harus dibangun hari ini.